Tehnologia Deepfake de la Facebook nu ne va salva, spun experții

- Pe măsură ce deepfake-urile devin mai ușor de realizat, modalitățile noi și îmbunătățite de a le identifica au devenit o prioritate.

- Tehnologia de deepfake-spotting de la Facebook folosește învățarea automată inversă pentru a descoperi dacă un videoclip este sau nu un deepfake.

- Experții spun că utilizarea tehnologiei blockchain ar fi cea mai bună modalitate de a vedea dacă un videoclip este real sau nu, deoarece metoda se bazează pe date contextuale.

Getty Images

Facebook are încredere în el model de învățare automată pentru combaterea deepfake-urilor, dar experții spun că învățarea automată de la sine nu ne va salva de a fi păcăliți de deepfakes.

Companii precum Facebook, Microsoft și Google toți lucrează pentru a combate deepfake-urile de la răspândirea pe web și rețelele sociale. Deși metodele diferă, există o metodă potențială sigură de a descoperi aceste videoclipuri false: blockchains.

„[Blockchains] vă oferă doar o mulțime de potențial de a valida deepfake-ul într-un mod care este cea mai bună formă de validare pe care o pot vedea”, Stephen Wolfram, fondator și CEO al

Tehnologia Deepfake-Spotting de la Facebook

Tehnologia Deepfake a crescut rapid în ultimii câțiva ani. Videoclipurile înșelătoare folosesc metode de învățare automată pentru a face lucruri precum suprapunerea feței cuiva pe corpul altei persoane, modificarea condițiilor de fundal, sincronizarea buzelor false și multe altele. Acestea variază de la parodii inofensive până la a le face pe celebrități sau persoane publice să spună sau să facă ceva ce nu au făcut.

Experții spun că tehnologia avansează rapid și că deepfake-urile vor deveni mai convingătoare (și mai ușor de creat) pe măsură ce tehnologia devine mai disponibilă și mai inovatoare.

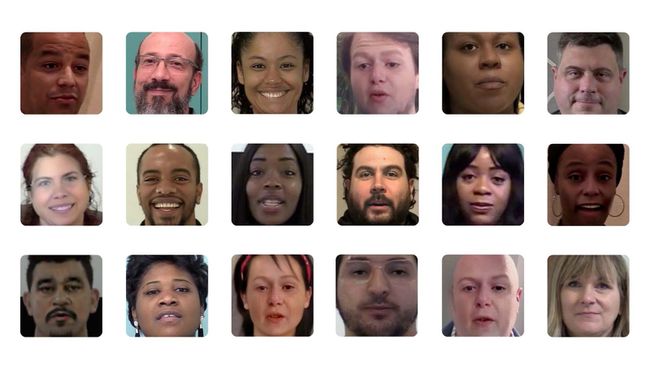

ApolitikNow / Flickr / CC By 2.0

Facebook a oferit recent mai multe informații despre tehnologia sa de detectare a falsurilor profunde în parteneriat cu Universitatea de Stat din Michigan. Rețeaua de socializare spune că se bazează pe inginerie inversă de la o singură imagine generată de inteligență artificială la modelul generativ folosit pentru a o produce.

Oamenii de știință care au lucrat cu Facebook au spus că metoda se bazează pe descoperirea tiparelor unice din spatele modelului AI folosit pentru a genera un deepfake.

„Prin generalizarea atribuirii imaginii la recunoașterea în set deschis, putem deduce mai multe informații despre model generativ folosit pentru a crea un deepfake care depășește recunoașterea faptului că nu a fost văzut inainte de. Și prin urmărirea asemănărilor între modelele unei colecții de deepfake, am putea spune și dacă o serie de imagini a apărut dintr-o singură sursă”, au scris cercetătorii Xi Yin și Tan Hassner în postarea de pe blog a Facebook despre reperarea sa profundă falsă. metodă.

Wolfram spune că este logic să folosiți învățarea automată pentru a identifica un model AI avansat (un deepfake). Cu toate acestea, există întotdeauna loc de a păcăli tehnologia.

„Nu sunt deloc surprins că există o modalitate decentă de învățare automată de [detectare deepfakes]”, a spus Wolfram. „Singura întrebare este dacă depui suficient efort, poți păcăli? Sunt sigur că poți.”

Combaterea Deepfake-urilor într-un mod diferit

În schimb, Wolfram a spus că el crede că utilizarea blockchain-ului ar fi cea mai bună opțiune pentru a identifica cu exactitate anumite tipuri de deepfake. Opinia sa despre utilizarea blockchain-ului în defavoarea învățării automate datează din 2019 și a spus că, în cele din urmă, abordarea blockchain poate oferi o soluție mai precisă la problema noastră deepfake.

„M-aș aștepta ca spectatorii de imagini și videoclipuri să poată verifica în mod obișnuit blocurile (și „triangularea datelor”. calcule’), cam așa cum browserele web verifică acum certificatele de securitate”, a scris Wolfram într-un articol publicat în Scientific American.

Deoarece blockchain-urile stochează date în blocuri care sunt apoi înlănțuite în ordine cronologică și deoarece blockchain-urile descentralizate sunt imuabile, datele introduse sunt ireversibile.

„Singura întrebare este dacă depui suficient efort, poți păcăli? Sunt sigur că poți.”

Wolfram a explicat că prin introducerea unui videoclip într-un blockchain, veți putea vedea timpul în care a fost luat, locația și alte informații contextuale care vă vor permite să spuneți dacă a fost modificată în vreunul cale.

„În general, cu cât există mai multe metadate care contextualizează imaginea sau videoclipul, cu atât este mai probabil să poți spune”, a spus el. „Nu poți falsifica timpul pe un blockchain.”

Cu toate acestea, Wolfram a spus că metoda utilizată – indiferent dacă este vorba de învățare automată sau de blockchain – depinde de tipul de deepfake pe care îl încercați. pentru a vă proteja împotriva (de exemplu, un videoclip cu Kim Kardashian spunând o prostie sau un videoclip cu un politician care face o declarație sau sugestie).

„Abordarea blockchain protejează împotriva anumitor tipuri de falsuri profunde, la fel cum procesarea imaginilor de învățare automată protejează împotriva anumitor tipuri de falsuri profunde”, a spus el.

Concluzia, se pare, este vigilența pentru noi toți atunci când vine vorba de combaterea potopului de deepfake care urmează.