IOS 15.2 Nakenhetsdeteksjon vil være på enheten og velges

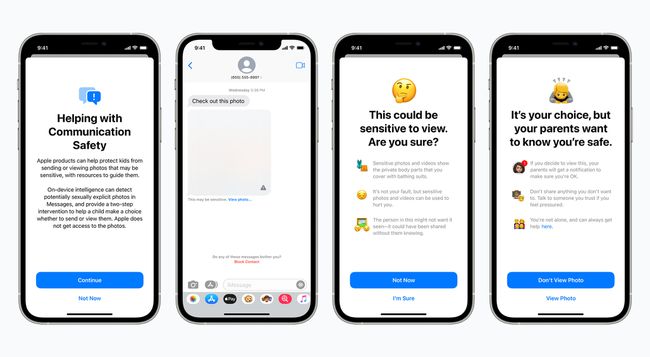

Apple vil presse videre med sin nakenhet-deteksjon, barnebeskyttelsesfunksjon i Messages-appen for iOS 15.2, men foreldre må slå den på.

Da Apple først avslørte sine barnevernfunksjoner, ble de møtt med en ganske kritisk respons, som resulterer i en forsinkelse av den planlagte utrullingen. Den største bekymringen for personvern – Apple skanner iCloud-bilder for materiale om seksuelt misbruk av barn (CSAM) – er fortsatt på vent, men i følge Bloomberg, er meldingsoppdateringen planlagt utgitt med iOS 15.2. Apple sier at den ikke vil være på som standard, men og at bildeanalyse vil skje på enheten, så den vil ikke ha tilgang til potensielt sensitive materialer.

RF-bilder / Getty Images

Ifølge Apple, når den er aktivert, vil funksjonen bruke maskinlæring på enheten for å oppdage om sendte eller mottatte bilder i Meldinger inneholder eksplisitt materiale. Dette vil uskarpe potensielt eksplisitte innkommende bilder og advare barnet eller gi dem en advarsel hvis de sender noe som kan være eksplisitt.

I begge tilfeller vil barnet også ha muligheten til å kontakte en forelder og fortelle dem hva som skjer. I en liste over ofte stilte spørsmål, opplyser Apple at for barnekontoer 12 og under, vil barnet bli advart om at en forelder vil bli kontaktet hvis de ser/sender eksplisitt materiale. For barnekontoer mellom 13-17 år advares barnet om den potensielle risikoen, men foreldre vil ikke bli kontaktet.

eple

I de samme vanlige spørsmålene insisterer Apple på at ingen av informasjonen vil bli delt med eksterne parter, inkludert Apple, rettshåndhevelse eller NCMEC (National Center for Missing & Exploited Children).

Disse nye barnesikkerhetsalternativene for meldinger skal være tilgjengelige i den kommende iOS 15.2-oppdateringen, som er forventes å rulle en gang denne måneden, i følge Macworld.