Facebook's Deepfake Tech zal ons niet redden, zeggen experts

- Naarmate deepfakes gemakkelijker te maken zijn, zijn nieuwe en verbeterde manieren om ze te spotten een prioriteit geworden.

- De deepfake-spotting-technologie van Facebook maakt gebruik van reverse machine learning om te ontdekken of een video een deepfake is of niet.

- Experts zeggen dat het gebruik van blockchain-technologie de beste manier is om te zien of een video echt is of niet, aangezien de methode afhankelijk is van contextuele gegevens.

Getty Images

Facebook heeft vertrouwen in zijn machine learning-model om deepfakes te bestrijden, maar experts zeggen dat machine learning op zichzelf ons niet zal behoeden voor misleiding door deepfakes.

Bedrijven zoals Facebook, Microsoft en Google ze werken allemaal om deepfakes te bestrijden van verspreiding over het web en sociale netwerken. Hoewel de methoden verschillen, is er één mogelijke onfeilbare methode om deze valse video's te herkennen: blockchains.

"[Blockchains] geven je gewoon veel potentieel om de deepfake te valideren op een manier die de beste vorm van validatie is die ik kan zien", Stephen Wolfram, oprichter en CEO van

Facebook's Deepfake-Spotting Tech

Deepfake-technologie is de afgelopen jaren snel gegroeid. De misleidende video's maken gebruik van machinale leermethoden om dingen te doen zoals iemands gezicht op het lichaam van een andere persoon plaatsen, achtergrondomstandigheden wijzigen, lipsynchronisatie faken en meer. Ze variëren van onschuldige parodieën tot het maken van beroemdheden of publieke figuren die iets zeggen of doen wat ze niet deden.

Experts zeggen dat de technologie snel vordert en dat deepfakes alleen maar overtuigender (en gemakkelijker te maken) zullen worden naarmate de technologie breder beschikbaar en innovatiever wordt.

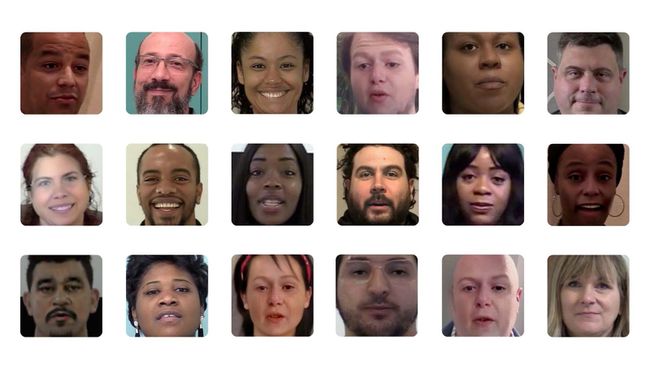

ApolitikNow / Flickr / CC door 2.0

Facebook gaf onlangs meer inzicht in zijn deepfake-detectietechnologie in samenwerking met Michigan State University. Het sociale netwerk zegt dat het vertrouwt op reverse engineering van een enkel door kunstmatige intelligentie gegenereerd beeld naar het generatieve model dat wordt gebruikt om het te produceren.

Onderzoekswetenschappers die met Facebook werkten, zeiden dat de methode gebaseerd is op het blootleggen van de unieke patronen achter het AI-model dat wordt gebruikt om een deepfake te genereren.

"Door beeldattributie te generaliseren naar open-set-herkenning, kunnen we meer informatie afleiden over de generatief model dat wordt gebruikt om een deepfake te maken die verder gaat dan erkennen dat het niet is gezien voordat. En door overeenkomsten te traceren tussen patronen van een verzameling deepfakes, konden we ook zien of een reeks afbeeldingen is ontstaan uit één enkele bron”, schreven onderzoekswetenschappers Xi Yin en Tan Hassner in de blogpost van Facebook over de deepfake-spotting methode.

Wolfram zegt dat het logisch is dat je machine learning zou gebruiken om een geavanceerd AI-model (een deepfake) te ontdekken. Er is echter altijd ruimte om de technologie voor de gek te houden.

"Het verbaast me helemaal niet dat er een degelijke machinale manier is om [deepfakes te detecteren]", zei Wolfram. “De enige vraag is of je genoeg moeite doet, kun je het voor de gek houden? Ik weet zeker dat je het kunt."

Deepfakes op een andere manier bestrijden

In plaats daarvan zei Wolfram dat hij gelooft dat het gebruik van blockchain de beste optie zou zijn om bepaalde soorten deepfakes nauwkeurig te herkennen. Zijn mening over het gebruik van blockchain in plaats van machine learning gaat terug tot 2019, en hij zei dat de blockchain-aanpak uiteindelijk een nauwkeuriger oplossing kan bieden voor ons deepfake-probleem.

"Ik zou verwachten dat beeld- en videokijkers routinematig zouden kunnen controleren op blockchains (en 'datatriangulatie') berekeningen') een beetje zoals hoe webbrowsers nu beveiligingscertificaten controleren', schreef Wolfram in een artikel gepubliceerd in Scientific American.

Omdat blockchains gegevens opslaan in blokken die vervolgens in chronologische volgorde aan elkaar worden geketend, en aangezien gedecentraliseerde blockchains onveranderlijk zijn, zijn de ingevoerde gegevens onomkeerbaar.

"De enige vraag is of je genoeg moeite doet, kun je het voor de gek houden? Ik weet zeker dat je het kunt."

Wolfram legde uit dat je door een video in een blockchain te plaatsen, de tijd zou kunnen zien die nodig was, de locatie en andere contextuele informatie waarmee u kunt zien of deze op een of andere manier is gewijzigd manier.

"Over het algemeen geldt dat hoe meer metadata er zijn die de foto of video contextualiseren, hoe groter de kans is dat je het kunt zien", zei hij. "Je kunt geen tijd vervalsen op een blockchain."

Wolfram zei echter dat de gebruikte methode - of het nu gaat om machine learning of het gebruik van blockchain - afhangt van het type deepfake dat je probeert te beschermen tegen (d.w.z. een video waarin Kim Kardashian iets doms zegt of een video van een politicus die een verklaring aflegt of suggestie).

"De blockchain-aanpak beschermt tegen bepaalde soorten diepe vervalsingen, net zoals de machine learning-beeldverwerking beschermt tegen bepaalde soorten diepe vervalsingen", zei hij.

De bottom line, zo lijkt het, is waakzaamheid voor ons allemaal als het gaat om het bestrijden van de komende deepfake zondvloed.