Nepasitikėkite niekuo, ką matote internete, sako ekspertai

Key Takeaways

- Nauji tyrimai atskleidžia, kad žmonės negali atskirti dirbtinio intelekto sukurtų vaizdų nuo tikrų.

- Dalyviai AI sukurtus vaizdus įvertino kaip patikimesnius.

- Ekspertai mano, kad žmonės turėtų nustoti pasitikėti viskuo, ką mato internete.

kentoh / Getty Images

Posakis „matyti – tai tikėti“ nebėra aktualus kalbant apie internetą, o ekspertai teigia, kad greitu metu jis nepagerės.

Neseniai atliktas tyrimas nustatė kad dirbtinio intelekto (DI) sukurti veidų vaizdai buvo ne tik labai tikroviški, bet ir atrodė labiau dorybingi nei tikri veidai.

„Mūsų DI sintezuotų veidų fotorealizmo įvertinimas rodo, kad sintezės varikliai praėjo keistą slėnyje ir gali sukurti veidus, kurie yra neišsiskiriantys ir patikimesni už tikrus veidus“, – pastebėjo tyrinėtojai.

Tas asmuo neegzistuoja

Tyrėjai, Daktarė Sophie Nightingale iš Lankasterio universiteto ir Profesorius Hany Faridas iš Kalifornijos universiteto Berklyje atliko eksperimentus po to, kai pripažino gerai išreklamuotos klastotės, nuo visų rūšių sukčiavimo internete iki pagyvinimo dezinformacijos kampanijos.

„Galbūt žalingiausia pasekmė, kad skaitmeniniame pasaulyje, kuriame bet koks vaizdas ar vaizdo įrašas gali būti suklastoti, gali kilti abejonių dėl bet kokio nepatogaus ar nepageidaujamo įrašo autentiškumo“, – tyrėjai ginčijosi.

Jie teigė, kad nors buvo padaryta pažanga kuriant automatinius metodus, skirtus aptikti giliai netikrą turinį, dabartinis metodai nėra pakankamai veiksmingi ir tikslūs, kad neatsiliktų nuo nuolatinio įkeliamo naujo turinio srauto prisijungęs. Tai reiškia, kad internetinio turinio vartotojai turi atskirti tikrąjį nuo netikro, siūlo duetas.

Jelle Wieringa, saugumo supratimo advokatas KnowBe4, sutiko. El. paštu jis pasakė „Lifewire“, kad be specializuotų technologijų labai sunku kovoti su tikrais klastotėmis. „[Mažinimo technologijos] gali būti brangios ir sunkiai įgyvendinamos realaus laiko procesuose, dažnai aptinkamos gilios klastotės tik po to.

Remdamiesi šia prielaida, mokslininkai atliko daugybę eksperimentų, siekdami nustatyti, ar žmonių dalyviai gali atskirti naujausius susintetintus veidus nuo tikrų veidų. Atlikdami bandymus jie nustatė, kad nepaisant mokymų, padedančių atpažinti padirbinius, tikslumo rodiklis tik pagerėjo iki 59%, palyginti su 48% be mokymo.

Tai paskatino mokslininkus patikrinti, ar patikimumo suvokimas gali padėti žmonėms atpažinti dirbtinius vaizdus. Trečiojo tyrimo metu jie paprašė dalyvių įvertinti veidų patikimumą, kad tik atrastų kad vidutinis sintetinių veidų įvertinimas buvo 7,7% patikimesnis nei vidutinis įvertinimas tikriems veidai. Skaičius gali pasirodyti ne toks didelis, bet mokslininkai tvirtina, kad jis statistiškai reikšmingas.

Gilesni klastotės

Gilios klastotės jau kėlė didelį susirūpinimą, o dabar šis tyrimas dar labiau drumstė vandenį, kuris rodo, kad aukštos kokybės netikri vaizdai gali suteikti visiškai naują internetinių sukčių aspektą, pavyzdžiui, padėdami sukurti įtikinamesnius internete netikri profiliai.

„Vienintelis dalykas, skatinantis kibernetinį saugumą, yra žmonių pasitikėjimas technologijomis, procesais ir žmonėmis, kurie stengiasi juos apsaugoti“, – dalijosi Wieringa. „Gilūs klastotės, ypač kai jos tampa fotorealistiškos, pakerta šį pasitikėjimą, taigi ir kibernetinio saugumo priėmimą bei pripažinimą. Tai gali paskatinti žmones nepasitikėti viskuo, ką suvokia.

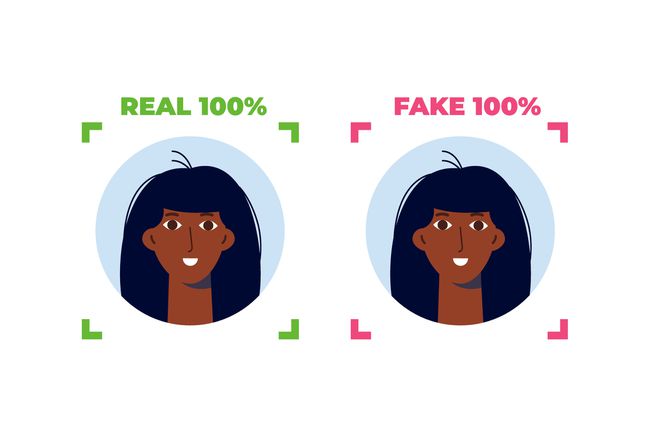

AndSim / Getty Images

Krisas Haukas, vartotojų privatumo čempionas „Pixel“ privatumas, sutiko. Trumpai pasikeisdamas el. paštu, jis pasakė „Lifewire“, kad fotorealistiškas gilus padirbinėjimas gali sukelti „sumaištį“ internete, ypač šiais laikais, kai gali būti įvairių paskyrų. pasiekiama naudojant ID technologiją su nuotrauka.

Koregavimo veiksmai

Dėkingai, Gregas Kuhnas, IoT direktorius, Prosegur Security, teigia, kad yra procesų, kurie gali išvengti tokio apgaulingo autentifikavimo. El. paštu jis pasakė Lifewire, kad dirbtiniu intelektu pagrįstos kredencialų suteikimo sistemos atitinka patikrintą asmenį pagal sąrašą, tačiau daugelis turi įmontuotų apsaugos priemonių, kad patikrintų, ar nėra „gyvumo“.

"Šių tipų sistemos gali reikalauti, kad vartotojas atliktų tam tikras užduotis, pvz., šypsotųsi arba pasuktų galvą į kairę, tada į dešinę, ir jos gali padėti. Tai yra dalykai, kurių statiškai sukurti veidai negalėjo atlikti“, – dalijosi Kuhnas.

Tyrėjai pasiūlė gaires, kaip reguliuoti jų kūrimą ir platinimą, kad apsaugotų visuomenę nuo sintetinių vaizdų. Pirmiausia jie siūlo įtraukti giliai įsišaknijusius vandens ženklus į pačius vaizdo ir vaizdo sintezės tinklus, kad būtų galima patikimai identifikuoti visas sintetines laikmenas.

Iki tada, Paulius Bischoffas, privatumo gynėjas ir infosec tyrimų redaktorius Comparitech, sako, kad žmonės yra vieni. „Žmonės turės išmokti nepasitikėti veidais internete, kaip mes visi (tikiuosi) išmokome nepasitikėti rodomais vardais savo el. laiškuose“, – el. paštu Lifewire sakė Bischoffas.