La tecnologia Deepfake di Facebook non ci salverà, dicono gli esperti

- Man mano che i deepfake diventano più facili da realizzare, nuovi e migliori modi per individuarli sono diventati una priorità.

- La tecnologia di individuazione dei deepfake di Facebook utilizza l'apprendimento automatico inverso per scoprire se un video è un deepfake o meno.

- Gli esperti affermano che l'utilizzo della tecnologia blockchain sarebbe il modo migliore per vedere se un video è reale o meno poiché il metodo si basa su dati contestuali.

Getty Images

Facebook è fiducioso nel suo modello di apprendimento automatico per combattere i deepfake, ma gli esperti dicono che il machine learning da solo non ci salverà dall'essere ingannati dai deepfake.

Aziende come Facebook, Microsoft e Google tutti stanno lavorando per combattere i deepfake dalla diffusione sul web e sui social network. Mentre i metodi differiscono, c'è un potenziale metodo infallibile per individuare questi falsi video: blockchain.

"[Blockchains] ti dà solo un sacco di potenziale per convalidare il deepfake in un modo che è la migliore forma di convalida che posso vedere", Stephen Wolfram, fondatore e CEO di

La tecnologia di individuazione dei deepfake di Facebook

La tecnologia Deepfake è cresciuta rapidamente negli ultimi anni. I video fuorvianti utilizzano metodi di apprendimento automatico per fare cose come sovrapporre il viso di qualcuno al corpo di un'altra persona, alterare le condizioni di sfondo, una falsa sincronizzazione labiale e altro ancora. Si va dalle innocue parodie al far dire o fare cose che celebrità o personaggi pubblici non hanno fatto.

Gli esperti affermano che la tecnologia sta avanzando rapidamente e che i deepfake diventeranno solo più convincenti (e più facili da creare) man mano che la tecnologia diventa più ampiamente disponibile e più innovativa.

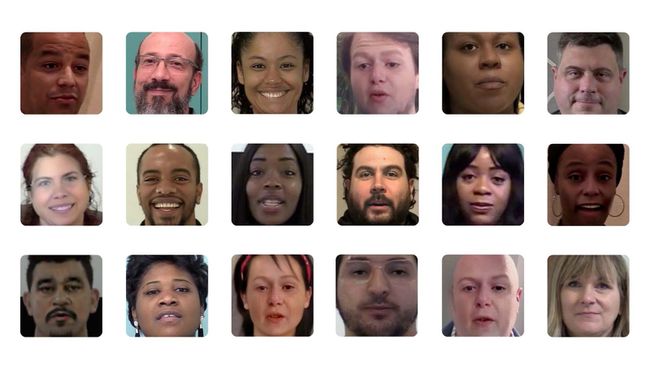

ApolitikNow / Flickr / CC By 2.0

Facebook ha recentemente fornito maggiori informazioni sulla sua tecnologia di rilevamento deepfake in collaborazione con la Michigan State University. Il social network afferma che si basa sul reverse engineering da una singola immagine generata dall'intelligenza artificiale al modello generativo utilizzato per produrla.

I ricercatori che hanno lavorato con Facebook hanno affermato che il metodo si basa sulla scoperta dei modelli unici dietro il modello di intelligenza artificiale utilizzato per generare un deepfake.

"Generalizzando l'attribuzione dell'immagine al riconoscimento dell'insieme aperto, possiamo dedurre maggiori informazioni sul modello generativo utilizzato per creare un deepfake che va oltre il riconoscimento che non è stato visto prima. E tracciando somiglianze tra i pattern di una raccolta di deepfake, potremmo anche dire se è nata una serie di immagini da un'unica fonte", hanno scritto i ricercatori Xi Yin e Tan Hassner nel post sul blog di Facebook sul suo deepfake-spotting metodo.

Wolfram afferma che è logico utilizzare l'apprendimento automatico per individuare un modello di intelligenza artificiale avanzato (un deepfake). Tuttavia, c'è sempre spazio per ingannare la tecnologia.

"Non sono affatto sorpreso che ci sia un modo decente di apprendimento automatico per [rilevare i deepfake]", ha detto Wolfram. “L'unica domanda è se ti impegni abbastanza, puoi ingannarlo? Sono sicuro che puoi.”

Combattere i deepfake in un modo diverso

Invece, Wolfram ha affermato di ritenere che l'utilizzo della blockchain sarebbe l'opzione migliore per individuare con precisione determinati tipi di deepfake. La sua opinione sull'utilizzo della blockchain rispetto all'apprendimento automatico risale al 2019 e ha affermato che, in definitiva, l'approccio blockchain può fornire una soluzione più accurata al nostro problema deepfake.

"Mi aspetterei che i visualizzatori di immagini e video possano controllare regolarmente contro blockchain (e 'triangolazione dei dati computations') un po' come il modo in cui i browser Web ora controllano i certificati di sicurezza", ha scritto Wolfram in un articolo pubblicato su Scientific American.

Poiché le blockchain memorizzano i dati in blocchi che vengono poi concatenati in ordine cronologico e poiché le blockchain decentralizzate sono immutabili, i dati inseriti sono irreversibili.

"L'unica domanda è se ti impegni abbastanza, puoi ingannarlo? Sono sicuro che puoi."

Wolfram ha spiegato che inserendo un video in una blockchain, saresti in grado di vedere il tempo che è stato impiegato, la posizione e altre informazioni contestuali che ti permetterebbero di dire se è stata alterata in qualche modo.

"In generale, avendo più metadati che ci sono che contestualizza l'immagine o il video, più è probabile che tu sia in grado di dirlo", ha detto. "Non puoi falsificare il tempo su una blockchain."

Tuttavia, Wolfram ha affermato che il metodo utilizzato, che si tratti di apprendimento automatico o utilizzo di blockchain, dipende dal tipo di deepfake che stai provando. per proteggersi (ad esempio, un video di Kim Kardashian che dice qualcosa di stupido o un video di un politico che fa una dichiarazione o suggerimento).

"L'approccio blockchain protegge da alcuni tipi di falsi profondi, proprio come l'elaborazione delle immagini di apprendimento automatico protegge da alcuni tipi di falsi profondi", ha affermato.

La linea di fondo, a quanto pare, è la vigilanza per tutti noi quando si tratta di combattere il prossimo diluvio deepfake.