Szakértők szerint a Facebook Deepfake Tech nem fog megmenteni minket

- Ahogy egyre könnyebben készíthetők mélyhamisítványok, a felismerésük új és továbbfejlesztett módjai prioritássá váltak.

- A Facebook deepfake-spotting technológiája fordított gépi tanulást használ annak felderítésére, hogy egy videó mélyhamisítás-e vagy sem.

- A szakértők szerint a blokklánc technológia használata lenne a legjobb módja annak, hogy megtudjuk, valódi-e egy videó, mivel a módszer kontextuális adatokon alapul.

Getty Images

A Facebook bízik benne gépi tanulási modell a mélyhamisítások leküzdésére, de a szakértők szerint a gépi tanulás önmagában nem ment meg minket attól, hogy a mélyhamisítások átverjék.

Olyan cégek, mint a Facebook, a Microsoft és a Google mindannyian a mélyhamisítások leküzdésén dolgoznak hogy elterjedjen az interneten és a közösségi hálózatokon. Bár a módszerek különböznek, van egy lehetséges bolondbiztos módszer ezeknek a hamis videóknak a felismerésére: a blokkláncok.

"A [Blockchains] rengeteg lehetőséget ad a mélyhamisítás érvényesítésére úgy, hogy az az általam látott legjobb érvényesítési forma." Stephen Wolfram, a cég alapítója és vezérigazgatója

A Facebook Deepfake-Spotting Tech

A Deepfake technológia gyorsan fejlődött az elmúlt néhány évben. A félrevezető videók gépi tanulási módszereket használnak, hogy például valaki arcát rávigyék egy másik személy testére, megváltoztassák a háttérfeltételeket, hamis ajakszinkronizálást stb. Ezek az ártalmatlan paródiáktól kezdve a hírességek vagy közéleti személyiségek olyasmit mondanak vagy csinálnak, amit nem tették meg.

A szakértők szerint a technológia gyorsan fejlődik, és a mélyhamisítások csak még meggyőzőbbek (és könnyebben létrehozhatók), ahogy a technológia szélesebb körben elérhetővé és innovatívabbá válik.

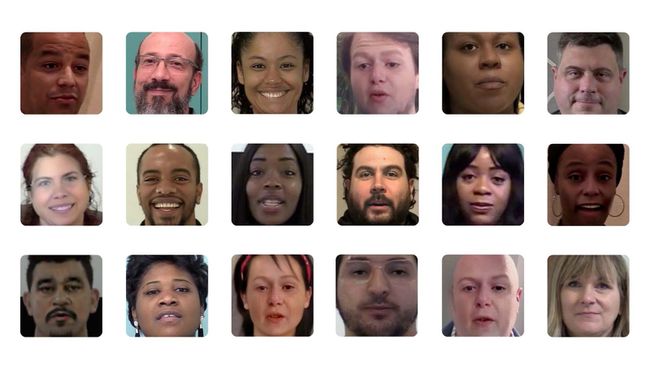

ApolitikNow / Flickr / CC By 2.0

A Facebook a közelmúltban a Michigan Állami Egyetemmel együttműködve részletesebb betekintést engedett a mélyhamisítás-felderítő technológiájába. A közösségi hálózat azt állítja, hogy az egyetlen mesterséges intelligencia által generált képtől a generatív modellig támaszkodik a visszafejtésre.

A Facebookkal dolgozó kutatók azt mondták, hogy a módszer a mélyhamisítás generálásához használt mesterséges intelligencia-modell mögötti egyedi minták feltárásán alapul.

„Ha általánosítjuk a képtulajdonítást a nyílt sorozatú felismerésre, több információra következtethetünk a generatív modell, amelyet egy mélyhamisítás létrehozására használnak, amely túlmutat annak felismerésén, hogy még nem látták előtt. A mélyhamisítások gyűjteményének mintái közötti hasonlóságok nyomon követésével azt is meg tudjuk állapítani, hogy egy képsorozat keletkezett-e egyetlen forrásból” – írták Xi Yin és Tan Hassner kutatók a Facebook blogbejegyzésében a mélyhamisításról. módszer.

Wolfram szerint logikus, hogy gépi tanulást használjon egy fejlett AI-modell (deephamis) észlelésére. Azonban mindig van hely a technológia megtévesztésére.

„Egyáltalán nem vagyok meglepve, hogy létezik egy tisztességes gépi tanulási módszer [a mélyhamisítások észlelésére]” – mondta Wolfram. „A kérdés csak az, hogy ha elég erőfeszítést teszel, be tudod csapni? Biztos vagyok benne, hogy képes vagy.”

A Deephamisítás elleni küzdelem más módon

Ehelyett Wolfram azt mondta, hogy szerinte a blokklánc használata lenne a legjobb megoldás bizonyos típusú mélyhamisítások pontos észlelésére. Véleménye a blokklánc használatáról a gépi tanulással szemben 2019-ig nyúlik vissza, és azt mondta, hogy végső soron a blokklánc-megközelítés pontosabb megoldást nyújthat a mélyhamisítási problémánkra.

„Arra számítok, hogy a kép- és videónézők rendszeresen ellenőrizni tudják a blokkláncokat (és az adatháromszögelést számítások) egy kicsit olyan, mint ahogyan a webböngészők most ellenőrzik a biztonsági tanúsítványokat” – írta Wolfram egy cikkében megjelent a Scientific Americanban.

Mivel a blokkláncok blokkokban tárolják az adatokat, amelyeket azután kronológiai sorrendben láncolnak össze, és mivel a decentralizált blokkláncok megváltoztathatatlanok, a bevitt adatok visszafordíthatatlanok.

"A kérdés csak az, hogy ha elég erőfeszítést teszel, be tudod csapni? Biztos vagyok benne, hogy képes vagy."

Wolfram elmagyarázta, hogy ha egy videót blokkláncba helyez, láthatja, hogy mennyi időt vett igénybe, a hely és egyéb kontextuális információk, amelyek segítségével megállapíthatja, hogy megváltoztak-e út.

„Általában elmondható, hogy minél több olyan metaadat van, amely kontextualizálja a képet vagy a videót, annál valószínűbb, hogy meg tudja mondani” – mondta. "Nem hamisíthatsz időt egy blokkláncon."

Wolfram azonban azt mondta, hogy az alkalmazott módszer – legyen az gépi tanulás vagy blokklánc használata – attól függ, hogy milyen mélyhamisítást próbál ki. ellen védekezni (azaz egy videó, amin Kim Kardashian valami butaságot mond, vagy egy videó, amin egy politikus nyilatkozik, ill. javaslat).

„A blokklánc-megközelítés védelmet nyújt bizonyos mélyhamisítások ellen, ahogy a gépi tanulási képfeldolgozás is véd bizonyos mélyhamisítások ellen” – mondta.

A lényeg, úgy tűnik, mindannyiunk ébersége, amikor a közelgő hamisított vízözön leküzdéséről van szó.