फेसबुक की डीपफेक तकनीक हमें नहीं बचाएगी, विशेषज्ञों का कहना है

- जैसे-जैसे डीपफेक बनाना आसान होता जा रहा है, उन्हें पहचानने के नए और बेहतर तरीके प्राथमिकता बन गए हैं।

- फेसबुक की डीपफेक-स्पॉटिंग तकनीक यह पता लगाने के लिए रिवर्स मशीन लर्निंग का उपयोग करती है कि कोई वीडियो डीपफेक है या नहीं।

- विशेषज्ञों का कहना है कि ब्लॉकचेन तकनीक का उपयोग यह देखने का सबसे अच्छा तरीका होगा कि वीडियो वास्तविक है या नहीं, क्योंकि यह विधि प्रासंगिक डेटा पर निर्भर करती है।

गेटी इमेजेज

फेसबुक को अपने पर पूरा भरोसा है डीपफेक से निपटने के लिए मशीन लर्निंग मॉडल, लेकिन विशेषज्ञों का कहना है कि मशीन लर्निंग अपने आप हमें डीपफेक द्वारा ठगे जाने से नहीं बचाएगी।

फेसबुक, माइक्रोसॉफ्ट और गूगल जैसी कंपनियां सभी डीपफेक का मुकाबला करने के लिए काम कर रहे हैं पूरे वेब और सामाजिक नेटवर्क में फैलने से। जबकि तरीके अलग-अलग हैं, इन झूठे वीडियो को खोजने के लिए एक संभावित मूर्खतापूर्ण तरीका है: ब्लॉकचेन।

"[ब्लॉकचेन] आपको डीपफेक को मान्य करने के लिए बहुत सारी संभावनाएं देता है जो कि सत्यापन का सबसे अच्छा रूप है जिसे मैं देख सकता हूं," स्टीफन वोल्फ्राम, संस्थापक और सीईओ वोल्फ्राम रिसर्च और के लेखक एक नए तरह का विज्ञान, लाइफवायर को फोन पर बताया।

फेसबुक का डीपफेक-स्पॉटिंग टेक

डीपफेक तकनीक पिछले कुछ वर्षों में तेजी से बढ़ी है। गुमराह करने वाले वीडियो मशीन लर्निंग के तरीकों का इस्तेमाल करते हैं, जैसे कि किसी का चेहरा दूसरे व्यक्ति के शरीर पर लगाना, बैकग्राउंड की स्थिति बदलना, नकली लिप-सिंक, और बहुत कुछ। वे हानिरहित पैरोडी से लेकर मशहूर हस्तियों या सार्वजनिक हस्तियों को कुछ ऐसा कहते या करते हैं जो उन्होंने नहीं किया।

विशेषज्ञों का कहना है कि तकनीक तेजी से आगे बढ़ रही है, और यह कि डीपफेक केवल अधिक आश्वस्त (और बनाने में आसान) हो जाएगा क्योंकि तकनीक अधिक व्यापक रूप से उपलब्ध और अधिक नवीन हो जाती है।

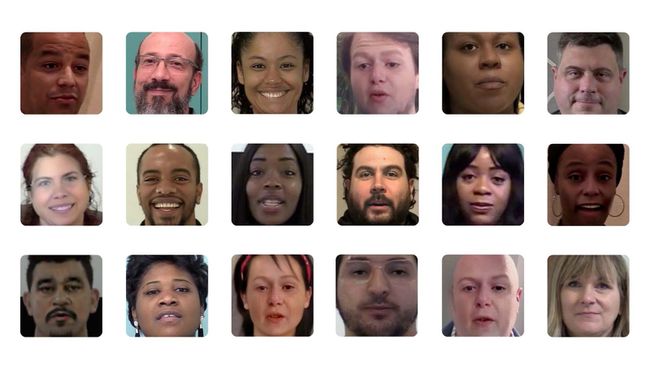

ApolitikNow / फ़्लिकर / सीसी द्वारा 2.0

फेसबुक ने हाल ही में मिशिगन स्टेट यूनिवर्सिटी के साथ साझेदारी में अपनी डीपफेक डिटेक्शन तकनीक के बारे में अधिक जानकारी दी है। सोशल नेटवर्क का कहना है कि यह एक आर्टिफिशियल इंटेलिजेंस-जनरेटेड इमेज से लेकर इसे बनाने के लिए इस्तेमाल किए जाने वाले जनरेटिव मॉडल तक रिवर्स इंजीनियरिंग पर निर्भर करता है।

फेसबुक के साथ काम करने वाले शोध वैज्ञानिकों ने कहा कि यह विधि डीपफेक उत्पन्न करने के लिए इस्तेमाल किए गए एआई मॉडल के पीछे के अनूठे पैटर्न को उजागर करने पर निर्भर करती है।

"ओपन-सेट पहचान के लिए छवि एट्रिब्यूशन को सामान्यीकृत करके, हम इसके बारे में अधिक जानकारी प्राप्त कर सकते हैं जनरेटिव मॉडल एक डीपफेक बनाने के लिए उपयोग किया जाता है जो यह पहचानने से परे है कि इसे देखा नहीं गया है इससे पहले। और डीपफेक के संग्रह के पैटर्न के बीच समानता का पता लगाकर, हम यह भी बता सकते हैं कि छवियों की एक श्रृंखला उत्पन्न हुई है या नहीं एक ही स्रोत से, ”शोध वैज्ञानिक शी यिन और टैन हसनर ने फेसबुक के ब्लॉग पोस्ट में इसके डीपफेक-स्पॉटिंग के बारे में लिखा तरीका।

फेसबुक

वोल्फ्राम का कहना है कि यह समझ में आता है कि आप उन्नत एआई मॉडल (एक डीपफेक) को खोजने के लिए मशीन लर्निंग का उपयोग करेंगे। हालाँकि, तकनीक को मूर्ख बनाने के लिए हमेशा जगह होती है।

"मैं बिल्कुल भी हैरान नहीं हूं कि [डीपफेक का पता लगाने] का एक अच्छा मशीन सीखने का तरीका है," वोल्फ्राम ने कहा। "एकमात्र प्रश्न यह है कि यदि आप पर्याप्त प्रयास करते हैं, तो क्या आप इसे मूर्ख बना सकते हैं? मुझे यकीन है कि आप कर सकते हैं।"

डीपफेक का एक अलग तरीके से मुकाबला करना

इसके बजाय, वोल्फ्राम ने कहा कि उनका मानना है कि कुछ प्रकार के डीपफेक को सटीक रूप से पहचानने के लिए ब्लॉकचेन का उपयोग करना सबसे अच्छा विकल्प होगा। मशीन लर्निंग पर ब्लॉकचेन का उपयोग करने के बारे में उनकी राय 2019 पर वापस जाती है, और उन्होंने कहा कि, अंततः, ब्लॉकचेन दृष्टिकोण हमारी गहरी नकली समस्या का अधिक सटीक समाधान प्रदान कर सकता है।

"मुझे उम्मीद है कि छवि और वीडियो दर्शक नियमित रूप से ब्लॉकचेन (और 'डेटा त्रिभुज') के खिलाफ जांच कर सकते हैं कंप्यूटेशंस') थोड़ा सा वेब ब्राउज़र अब सुरक्षा प्रमाणपत्रों की जांच कैसे करता है, "वोल्फ्राम ने एक लेख में लिखा था साइंटिफिक अमेरिकन में प्रकाशित.

चूंकि ब्लॉकचेन डेटा को उन ब्लॉकों में संग्रहीत करता है जो कालानुक्रमिक क्रम में एक साथ जंजीर में बंधे होते हैं, और चूंकि विकेन्द्रीकृत ब्लॉकचेन अपरिवर्तनीय होते हैं, इसलिए दर्ज किया गया डेटा अपरिवर्तनीय होता है।

"एकमात्र प्रश्न यह है कि यदि आप पर्याप्त प्रयास करते हैं, तो क्या आप इसे मूर्ख बना सकते हैं? मुझे यकीन है कि आप कर सकते हैं।"

वोल्फ्राम ने समझाया कि एक वीडियो को ब्लॉकचेन में डालने से, आप देख पाएंगे कि इसमें कितना समय लगा था, स्थान, और अन्य प्रासंगिक जानकारी जो आपको यह बताने की अनुमति देगी कि क्या इसे किसी में बदल दिया गया है रास्ता।

"सामान्य तौर पर, जितना अधिक मेटाडेटा होता है, वह चित्र या वीडियो को संदर्भित करता है, उतनी ही अधिक संभावना है कि आप बताने में सक्षम होंगे," उन्होंने कहा। "आप ब्लॉकचेन पर नकली समय नहीं बना सकते।"

हालांकि, वोल्फ्राम ने कहा कि इस्तेमाल की जाने वाली विधि-चाहे वह मशीन लर्निंग हो या ब्लॉकचेन का उपयोग कर रही हो - आप जिस तरह के डीपफेक की कोशिश कर रहे हैं उस पर निर्भर करता है से बचाव करने के लिए (यानी किम कार्दशियन का मूर्खतापूर्ण कुछ कहने का वीडियो या किसी राजनेता का बयान देने वाला वीडियो या सुझाव)।

"ब्लॉकचेन दृष्टिकोण कुछ प्रकार के गहरे नकली से बचाता है, जैसे मशीन लर्निंग इमेज प्रोसेसिंग कुछ प्रकार के गहरे नकली से बचाता है," उन्होंने कहा।

ऐसा लगता है कि नीचे की रेखा, हम सभी के लिए सतर्कता है, जब आने वाले गहरे नकली जलप्रलय का मुकाबला करने की बात आती है।