La technologie Deepfake de Facebook ne nous sauvera pas, selon les experts

- À mesure que les deepfakes deviennent plus faciles à créer, des moyens nouveaux et améliorés de les repérer sont devenus une priorité.

- La technologie de détection de deepfake de Facebook utilise l'apprentissage automatique inversé pour découvrir si une vidéo est un deepfake ou non.

- Les experts disent que l'utilisation de la technologie blockchain serait le meilleur moyen de voir si une vidéo est réelle ou non, car la méthode repose sur des données contextuelles.

Getty Images

Facebook est confiant dans son modèle d'apprentissage automatique pour lutter contre les deepfakes, mais les experts disent que l'apprentissage automatique à lui seul ne nous évitera pas d'être dupés par les deepfakes.

Des entreprises comme Facebook, Microsoft et Google tous travaillent pour lutter contre les deepfakes de se répandre sur le Web et les réseaux sociaux. Bien que les méthodes diffèrent, il existe une méthode potentielle infaillible pour repérer ces fausses vidéos: les blockchains.

"[Blockchains] vous donne juste beaucoup de potentiel pour valider le deepfake d'une manière qui est la meilleure forme de validation que je puisse voir", Stephen Wolfram, fondateur et PDG de

La technologie de détection de Deepfake de Facebook

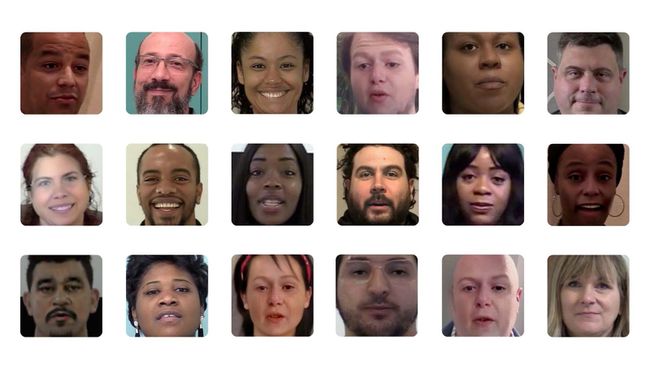

La technologie Deepfake a connu une croissance rapide au cours des dernières années. Les vidéos trompeuses utilisent des méthodes d'apprentissage automatique pour faire des choses comme superposer le visage de quelqu'un sur le corps d'une autre personne, modifier les conditions d'arrière-plan, fausser la synchronisation labiale, etc. Ils vont de parodies inoffensives à obliger des célébrités ou des personnalités publiques à dire ou à faire quelque chose qu'elles n'ont pas fait.

Les experts disent que la technologie progresse rapidement et que les deepfakes deviendront de plus en plus convaincants (et plus faciles à créer) à mesure que la technologie deviendra plus largement disponible et plus innovante.

ApolitikNow / Flickr / CC By 2.0

Facebook a récemment donné plus d'informations sur sa technologie de détection de deepfake en partenariat avec la Michigan State University. Le réseau social dit qu'il s'appuie sur l'ingénierie inverse d'une seule image générée par l'intelligence artificielle au modèle génératif utilisé pour la produire.

Les chercheurs qui ont travaillé avec Facebook ont déclaré que la méthode repose sur la découverte des modèles uniques derrière le modèle d'IA utilisé pour générer un deepfake.

« En généralisant l'attribution d'images à la reconnaissance d'ensembles ouverts, nous pouvons en déduire plus d'informations sur la modèle génératif utilisé pour créer un deepfake qui va au-delà de la reconnaissance qu'il n'a pas été vu avant. Et en retraçant les similitudes entre les modèles d'une collection de deepfakes, nous pourrions également dire si une série d'images est originaire à partir d'une seule source », ont écrit les chercheurs Xi Yin et Tan Hassner dans le blog de Facebook à propos de son deepfake-spotting méthode.

Wolfram dit qu'il est logique que vous utilisiez l'apprentissage automatique pour repérer un modèle d'IA avancé (un deepfake). Cependant, il y a toujours de la place pour tromper la technologie.

"Je ne suis pas du tout surpris qu'il existe un moyen d'apprentissage machine décent pour [détecter les deepfakes]", a déclaré Wolfram. « La seule question est que si vous faites suffisamment d'efforts, pouvez-vous le tromper? Je suis sûr que vous le pouvez.

Combattre les Deepfakes d'une manière différente

Au lieu de cela, Wolfram a déclaré qu'il pensait que l'utilisation de la blockchain serait la meilleure option pour repérer avec précision certains types de deepfakes. Son opinion sur l'utilisation de la blockchain par rapport à l'apprentissage automatique remonte à 2019, et il a déclaré qu'en fin de compte, l'approche blockchain peut fournir une solution plus précise à notre problème de deepfake.

"Je m'attendrais à ce que les téléspectateurs d'images et de vidéos puissent vérifier régulièrement les chaînes de blocs (et" la triangulation des données calculs ») un peu comme la façon dont les navigateurs Web vérifient désormais les certificats de sécurité », a écrit Wolfram dans un article publié dans Scientific American.

Étant donné que les blockchains stockent les données dans des blocs qui sont ensuite enchaînés par ordre chronologique et que les blockchains décentralisées sont immuables, les données saisies sont irréversibles.

« La seule question est que si vous faites suffisamment d'efforts, pouvez-vous le tromper? Je suis sûr que vous le pouvez."

Wolfram a expliqué qu'en mettant une vidéo dans une blockchain, vous pourriez voir le temps qu'elle a été prise, l'emplacement, et d'autres informations contextuelles qui vous permettraient de dire s'il a été modifié dans n'importe quel manière.

"En général, plus il y a de métadonnées qui contextualisent l'image ou la vidéo, plus vous avez de chances de pouvoir le dire", a-t-il déclaré. « Vous ne pouvez pas simuler l'heure sur une blockchain. »

Cependant, Wolfram a déclaré que la méthode utilisée, qu'il s'agisse d'apprentissage automatique ou d'utilisation de la blockchain, dépend du type de deepfake que vous essayez. se protéger contre (c'est-à-dire une vidéo de Kim Kardashian disant quelque chose de stupide ou une vidéo d'un politicien faisant une déclaration ou suggestion).

"L'approche blockchain protège contre certains types de contrefaçons profondes, tout comme le traitement d'image par apprentissage automatique protège contre certains types de contrefaçons profondes", a-t-il déclaré.

L'essentiel, semble-t-il, est la vigilance de chacun d'entre nous lorsqu'il s'agit de lutter contre le déluge de deepfake à venir.