¿Hacia dónde va la fotografía computacional a continuación?

Conclusiones clave

- Las nuevas cámaras Pixel 6 de Google tienen más trucos informáticos que nunca.

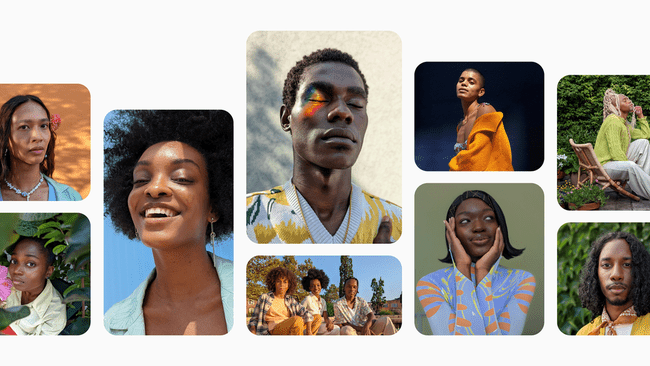

- Por último, las personas que no son de raza blanca son una prioridad en los algoritmos de Google.

- Aún debe saber hacia dónde apuntar la cámara para obtener una gran toma.

Los nuevos teléfonos Pixel 6 de Google son cámaras con un teléfono adjunto.

Al igual que el iPhone, los nuevos píxeles de Google vienen en niveles regular y Pro y tienen grandes golpes de cámara imperdibles en la parte posterior. En el caso de Google, la protuberancia es una barra que se extiende a lo ancho del dispositivo. Se ve genial y alberga una impresionante variedad de lentes y sensores nuevos.

Pero, al igual que el iPhone, lo que cuenta es lo que hay dentro. La fotografía computacional se está apoderando de la fotografía, pero ¿hacia dónde se dirige?

"Aquellos que promueven la fotografía computacional (y basada en IA) han prometido durante años algoritmos y tecnología que pueden convertir la fotografía promedio en algo de lo que un fotógrafo profesional se enorgullecería, pero esto todavía está un poco lejos ", fotógrafo

Fotografía Computacional

La fotografía computacional comenzó como una forma de transformar las horribles imágenes de las primeras cámaras de los teléfonos inteligentes en imágenes que podía ver y disfrutar. Los diminutos lentes y sensores de los teléfonos tenían problemas con poca luz y tenían problemas para capturar detalles intrincados.

Pero luego, los chips dedicados al procesamiento de imágenes como el Neural Engine de Apple, capaz de realizar billones de operaciones en un segundo, transformaron las imágenes. Ahora tenemos modos de retrato con desenfoque de fondo, modos nocturnos que brindan imágenes asombrosas casi en la oscuridad, "modo suéter", que combina varias imágenes para proporcionar mejores detalles, junto con trucos de magia como la detección de parpadeo, lo que significa que los ojos medio cerrados nunca estropean el grupo disparos.

La belleza de todos estos trucos es que todo lo que tienes que hacer es encuadrar tu toma y el teléfono ofrece una toma perfecta en todo momento. Por otro lado, los fotógrafos no siempre quieren una toma "perfecta".

"Personalmente, no creo que la fotografía computacional tenga una gran cuota de mercado entre los fotógrafos aficionados como yo. Disfrutamos de la fotografía por sí misma, seleccionando la exposición, la apertura, el encuadre y cosas por el estilo, y ceder esto a un algoritmo eliminaría gran parte de la diversión de la fotografía ", dijo Daniels.

El Pixel 6

Las cámaras dentro de los nuevos teléfonos son impresionantes. Ambos modelos tienen una cámara amplia y ultra ancha, y el Pro agrega un telefoto 4X, pero el hardware es solo una parte de la historia.

Por ejemplo, Borrador mágico le permite eliminar los elementos que distraen de la foto. No solo eso, sino que la cámara detecta estos elementos automáticamente y sugiere su eliminación. Simplemente confirme con un toque.

Borrador mágico

¿O qué tal un desenfoque de la cara? Si el sujeto se mueve rápido con poca luz, esta función intenta desenfocar su rostro. Es perfecto para tomar instantáneas de niños que se mueven rápidamente (todos los niños que no duermen) en interiores. Y el modo de movimiento hace lo contrario: desenfoca deliberadamente los elementos que se mueven para lograr el efecto.

Quizás la mejor característica sea la más sutil. Tono real permite que las cámaras reproduzcan correctamente cualquier tono de piel. "Con Pixel 6, mejoramos enormemente nuestros algoritmos y modelos de ajuste de cámara para resaltar con mayor precisión los matices de diversos tonos de piel". dice el blog de cámaras de Google.

Google trabajó con fotógrafos negros, indígenas y de personas de color (BIPOC) para crear las imágenes utilizadas para entrenar los algoritmos. Dado que prejuicio étnico que se ha incorporado a la fotografía desde los primeros días del cine, esto es un gran problema.

Mejores imágenes, menos esfuerzo

La fotografía computacional parece tener dos propósitos en este momento. Una es darte una foto increíble, sin importar las condiciones. La otra es imitar técnicas que a menudo requieren mucho conocimiento y habilidad para lograr "a mano" en una cámara normal.

De alguna manera, esto corre el riesgo de hacer que todas nuestras fotos se vean iguales. Por otro lado, eche un vistazo a cualquiera de las fotos de los miembros de cualquier club de cámaras a lo largo de las décadas, y están igualmente llenas de clichés. Desde la regla de los tercios hasta el uso de velocidades de obturación lentas para difuminar las cascadas, hasta el instinto casi inquebrantable de hacer sonreír a la gente en las fotos.

"Aunque el Pixel 6 es la próxima evolución de esta tecnología, todavía se encuentra en las primeras etapas de fotografía computacional y no significa que puedas tomar fotos de alta calidad sin habilidad ", dice Daniels.

Para aquellos que prefieren superar estos clichés, nada cambia. Pero para las personas que solo quieren excelentes fotografías de la familia, los amigos, los lugares y el desayuno, la fotografía computacional es lo mejor que existe. Imagínese lo diferente que sería su mundo si todas esas viejas instantáneas impresas en álbumes familiares fueran tan buenas como las fotos que toma con su teléfono.