Η τεχνολογία Deepfake του Facebook δεν θα μας σώσει, λένε οι ειδικοί

- Καθώς τα deepfakes γίνονται πιο εύκολα, νέοι και βελτιωμένοι τρόποι εντοπισμού τους έχουν γίνει προτεραιότητα.

- Η τεχνολογία deepfake-spotting του Facebook χρησιμοποιεί αντίστροφη μηχανική εκμάθηση για να αποκαλύψει εάν ένα βίντεο είναι ψεύτικο ή όχι.

- Οι ειδικοί λένε ότι η χρήση τεχνολογίας blockchain θα ήταν ο καλύτερος τρόπος για να δούμε αν ένα βίντεο είναι πραγματικό ή όχι, καθώς η μέθοδος βασίζεται σε δεδομένα συμφραζομένων.

Getty Images

Το Facebook είναι σίγουρο για αυτό μοντέλο μηχανικής εκμάθησης για την καταπολέμηση των deepfakes, αλλά οι ειδικοί λένε ότι η μηχανική μάθηση από μόνη της δεν θα μας σώσει από την εξαπάτηση των deepfakes.

Εταιρείες όπως το Facebook, η Microsoft και η Google όλοι εργάζονται για την καταπολέμηση των deepfakes από τη διάδοση στον ιστό και τα κοινωνικά δίκτυα. Αν και οι μέθοδοι διαφέρουν, υπάρχει μια πιθανή ανόητη μέθοδος για να εντοπίσετε αυτά τα ψευδή βίντεο: τα blockchains.

«[Οι αλυσίδες μπλοκ] απλώς σας δίνουν πολλές δυνατότητες να επικυρώσετε το deepfake με τρόπο που είναι η καλύτερη μορφή επικύρωσης που μπορώ να δω», Stephen Wolfram, ιδρυτής και διευθύνων σύμβουλος της

Η τεχνολογία Deepfake-Spotting του Facebook

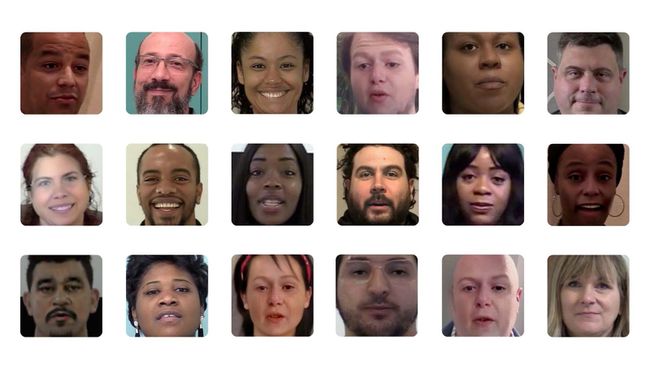

Η τεχνολογία Deepfake έχει αναπτυχθεί ραγδαία τα τελευταία χρόνια. Τα παραπλανητικά βίντεο χρησιμοποιούν μεθόδους μηχανικής εκμάθησης για να κάνουν πράγματα όπως η τοποθέτηση του προσώπου κάποιου στο σώμα άλλου ατόμου, η αλλαγή συνθηκών φόντου, ο ψεύτικος συγχρονισμός των χειλιών και πολλά άλλα. Κυμαίνονται από αβλαβείς παρωδίες μέχρι να κάνουν διασημότητες ή δημόσια πρόσωπα να λένε ή να κάνουν κάτι που δεν έκαναν.

Οι ειδικοί λένε ότι η τεχνολογία προχωρά γρήγορα και ότι τα deepfakes θα γίνουν πιο πειστικά (και πιο εύκολα στη δημιουργία) καθώς η τεχνολογία γίνεται πιο ευρέως διαθέσιμη και πιο καινοτόμα.

ApolitikNow / Flickr / CC By 2.0

Το Facebook έδωσε πρόσφατα περισσότερες πληροφορίες σχετικά με την τεχνολογία ανίχνευσης ψεύτικο ψεύτικο σε συνεργασία με το Πολιτειακό Πανεπιστήμιο του Μίσιγκαν. Το κοινωνικό δίκτυο λέει ότι βασίζεται στην αντίστροφη μηχανική από μια ενιαία εικόνα που δημιουργείται από τεχνητή νοημοσύνη έως το μοντέλο παραγωγής που χρησιμοποιείται για την παραγωγή της.

Οι ερευνητές που συνεργάστηκαν με το Facebook είπαν ότι η μέθοδος βασίζεται στην αποκάλυψη των μοναδικών μοτίβων πίσω από το μοντέλο AI που χρησιμοποιείται για τη δημιουργία ενός deepfake.

«Γενεύοντας την απόδοση εικόνας στην αναγνώριση ανοιχτού συνόλου, μπορούμε να συμπεράνουμε περισσότερες πληροφορίες σχετικά με το γενετικό μοντέλο που χρησιμοποιείται για τη δημιουργία ενός deepfake που ξεπερνά την αναγνώριση ότι δεν έχει εμφανιστεί πριν. Και ανιχνεύοντας ομοιότητες μεταξύ των μοτίβων μιας συλλογής deepfakes, θα μπορούσαμε επίσης να πούμε αν προήλθε μια σειρά από εικόνες από μία μόνο πηγή», έγραψαν οι ερευνητές Xi Yin και Tan Hassner στην ανάρτηση ιστολογίου του Facebook σχετικά με τον εντοπισμό του σε βάθος ψεύτικου μέθοδος.

Ο Wolfram λέει ότι είναι λογικό να χρησιμοποιείτε μηχανική εκμάθηση για να εντοπίσετε ένα προηγμένο μοντέλο AI (ένα βαθύ ψεύτικο). Ωστόσο, υπάρχει πάντα χώρος για να ξεγελάσεις την τεχνολογία.

«Δεν εκπλήσσομαι καθόλου που υπάρχει ένας αξιοπρεπής τρόπος μηχανικής εκμάθησης [ανίχνευσης deepfakes]», είπε ο Wolfram. «Το μόνο ερώτημα είναι αν καταβάλεις αρκετή προσπάθεια, μπορείς να το ξεγελάσεις; Είμαι σίγουρος ότι μπορείς."

Καταπολέμηση των Deepfakes με διαφορετικό τρόπο

Αντίθετα, ο Wolfram είπε ότι πιστεύει ότι η χρήση blockchain θα ήταν η καλύτερη επιλογή για τον ακριβή εντοπισμό ορισμένων τύπων deepfakes. Η άποψή του για τη χρήση του blockchain έναντι της μηχανικής μάθησης χρονολογείται από το 2019 και είπε ότι, τελικά, η προσέγγιση blockchain μπορεί να προσφέρει μια πιο ακριβή λύση στο πρόβλημά μας με το deepfake.

«Θα περίμενα ότι οι θεατές εικόνων και βίντεο θα μπορούσαν να ελέγχουν τακτικά με blockchains (και «τριγωνισμό δεδομένων υπολογισμοί') λίγο σαν τον τρόπο με τον οποίο τα προγράμματα περιήγησης ιστού ελέγχουν τώρα τα πιστοποιητικά ασφαλείας», έγραψε ο Wolfram σε ένα άρθρο δημοσιεύτηκε στο Scientific American.

Δεδομένου ότι οι αλυσίδες μπλοκ αποθηκεύουν δεδομένα σε μπλοκ που στη συνέχεια συνδέονται μεταξύ τους με χρονολογική σειρά και δεδομένου ότι οι αποκεντρωμένες αλυσίδες μπλοκ είναι αμετάβλητες, τα δεδομένα που εισάγονται είναι μη αναστρέψιμα.

«Το μόνο ερώτημα είναι αν καταβάλεις αρκετή προσπάθεια, μπορείς να το ξεγελάσεις; Είμαι σίγουρος ότι μπορείς».

Ο Wolfram εξήγησε ότι τοποθετώντας ένα βίντεο σε ένα blockchain, θα μπορείτε να δείτε τον χρόνο λήψης του, την τοποθεσία και άλλες πληροφορίες σχετικά με τα συμφραζόμενα που θα σας επιτρέψουν να πείτε εάν έχει αλλάξει σε κάποια τρόπος.

«Γενικά, όσο περισσότερα μεταδεδομένα υπάρχουν που διαμορφώνουν την εικόνα ή το βίντεο, τόσο πιο πιθανό είναι να μπορείτε να το πείτε», είπε. «Δεν μπορείς να πλαστογραφήσεις χρόνο σε blockchain».

Ωστόσο, ο Wolfram είπε ότι η μέθοδος που χρησιμοποιείται - είτε πρόκειται για μηχανική μάθηση είτε για χρήση blockchain - εξαρτάται από τον τύπο του deepfake που δοκιμάζετε για προστασία από (δηλαδή, ένα βίντεο της Κιμ Καρντάσιαν να λέει κάτι ανόητο ή ένα βίντεο ενός πολιτικού που κάνει μια δήλωση ή πρόταση).

«Η προσέγγιση του blockchain προστατεύει από ορισμένα είδη απομιμήσεων σε βάθος, όπως η επεξεργασία εικόνων μηχανικής μάθησης προστατεύει από ορισμένα είδη απομιμήσεων σε βάθος», είπε.

Η ουσία, φαίνεται, είναι η επαγρύπνηση για όλους μας όταν πρόκειται να καταπολεμήσουμε τον επερχόμενο κατακλυσμό του deepfake.