Facebooks Deepfake-Technologie wird uns nicht retten, sagen Experten

- Da Deepfakes einfacher zu erstellen sind, haben neue und verbesserte Möglichkeiten, sie zu erkennen, Priorität.

- Die Deepfake-Spotting-Technologie von Facebook verwendet umgekehrtes maschinelles Lernen, um herauszufinden, ob ein Video ein Deepfake ist oder nicht.

- Experten sagen, dass die Verwendung der Blockchain-Technologie der beste Weg wäre, um zu sehen, ob ein Video echt ist oder nicht, da die Methode auf kontextbezogenen Daten beruht.

Getty Images

Facebook ist überzeugt von seiner Machine-Learning-Modell zur Bekämpfung von Deepfakes, aber Experten sagen, dass maschinelles Lernen allein uns nicht davor bewahren wird, von Deepfakes getäuscht zu werden.

Unternehmen wie Facebook, Microsoft und Google alle arbeiten daran, Deepfakes zu bekämpfen Verbreitung im Internet und in sozialen Netzwerken. Obwohl sich die Methoden unterscheiden, gibt es eine potenziell narrensichere Methode, um diese falschen Videos zu erkennen: Blockchains.

„[Blockchains] geben Ihnen einfach viel Potenzial, um den Deepfake auf eine Weise zu validieren, die die beste Form der Validierung ist, die ich sehen kann“, Stephen Wolfram, Gründer und CEO von

Facebooks Deepfake-Spotting-Technologie

Die Deepfake-Technologie ist in den letzten Jahren rasant gewachsen. Die irreführenden Videos verwenden Methoden des maschinellen Lernens, um Dinge wie das Gesicht einer anderen Person auf den Körper einer anderen Person zu legen, die Hintergrundbedingungen zu ändern, die Lippensynchronisation zu fälschen und vieles mehr. Sie reichen von harmlosen Parodien bis hin zu Prominenten oder Persönlichkeiten des öffentlichen Lebens, etwas zu sagen oder zu tun, was sie nicht getan haben.

Experten sagen, dass die Technologie schnell voranschreitet und dass Deepfakes nur überzeugender (und einfacher zu erstellen) werden, wenn die Technologie breiter verfügbar und innovativer wird.

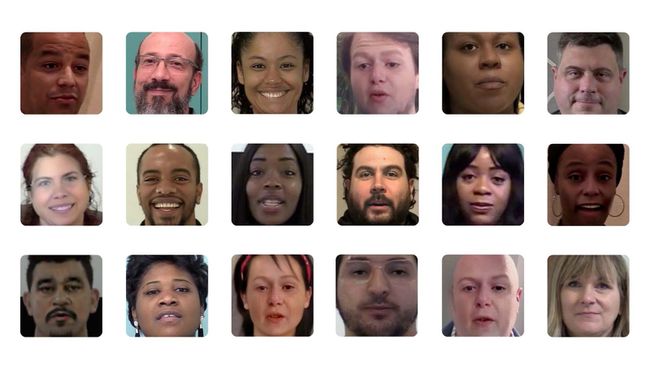

ApolitikNow / Flickr / CC By 2.0

Facebook hat kürzlich in Zusammenarbeit mit der Michigan State University weitere Einblicke in seine Deepfake-Erkennungstechnologie gegeben. Das soziale Netzwerk sagt, dass es auf Reverse Engineering von einem einzelnen, mit künstlicher Intelligenz generierten Bild bis hin zu dem generativen Modell beruht, das zu seiner Herstellung verwendet wird.

Forscher, die mit Facebook zusammengearbeitet haben, sagten, dass die Methode darauf beruht, die einzigartigen Muster hinter dem KI-Modell aufzudecken, mit dem ein Deepfake generiert wird.

„Durch die Verallgemeinerung der Bildzuordnung zur Open-Set-Erkennung können wir mehr Informationen über die Generatives Modell, das verwendet wird, um einen Deepfake zu erstellen, der über das Erkennen hinausgeht, dass es nicht gesehen wurde Vor. Und indem wir Ähnlichkeiten zwischen Mustern einer Sammlung von Deepfakes verfolgen, können wir auch feststellen, ob eine Reihe von Bildern entstanden ist aus einer Hand“, schreiben die Forscher Xi Yin und Tan Hassner im Facebook-Blog über das Deepfake-Spotting Methode.

Wolfram sagt, dass es sinnvoll ist, maschinelles Lernen zu verwenden, um ein fortschrittliches KI-Modell (ein Deepfake) zu erkennen. Es gibt jedoch immer Raum, die Technologie zu täuschen.

„Ich bin überhaupt nicht überrascht, dass es eine anständige Methode des maschinellen Lernens gibt, um Deepfakes zu erkennen“, sagte Wolfram. „Die Frage ist nur, wenn Sie sich genug Mühe geben, können Sie es täuschen? Ich bin sicher, dass Sie das können.“

Deepfakes anders bekämpfen

Stattdessen sagte Wolfram, dass er glaubt, dass die Verwendung von Blockchain die beste Option wäre, um bestimmte Arten von Deepfakes genau zu erkennen. Seine Meinung zur Verwendung von Blockchain gegenüber maschinellem Lernen geht auf das Jahr 2019 zurück, und er sagte, dass der Blockchain-Ansatz letztendlich eine genauere Lösung für unser Deepfake-Problem bieten kann.

„Ich würde erwarten, dass Bild- und Videobetrachter routinemäßig gegen Blockchains (und ‚Datentriangulation‘) prüfen könnten Berechnungen') ein bisschen so, wie Webbrowser jetzt Sicherheitszertifikate überprüfen“, schrieb Wolfram in einem Artikel veröffentlicht in Scientific American.

Da Blockchains Daten in Blöcken speichern, die dann in chronologischer Reihenfolge miteinander verkettet werden, und da dezentrale Blockchains unveränderlich sind, sind die eingegebenen Daten irreversibel.

„Die einzige Frage ist, wenn Sie sich genug Mühe geben, können Sie es täuschen? Ich bin sicher, dass Sie das können."

Wolfram erklärte, dass Sie durch das Einfügen eines Videos in eine Blockchain die Zeit sehen können, in der es aufgenommen wurde. den Standort und andere kontextbezogene Informationen, anhand derer Sie feststellen können, ob sie in irgendeiner Weise geändert wurden Weg.

„Im Allgemeinen ist es umso wahrscheinlicher, dass Sie es erkennen können, je mehr Metadaten vorhanden sind, die das Bild oder Video kontextualisieren“, sagte er. „Man kann die Zeit auf einer Blockchain nicht vortäuschen.“

Wolfram sagte jedoch, dass die verwendete Methode – ob maschinelles Lernen oder Blockchain – von der Art des Deepfakes abhängt, das Sie versuchen zu schützen (z. B. ein Video von Kim Kardashian, das etwas Dummes sagt oder ein Video von einem Politiker, der eine Aussage macht oder Anregung).

„Der Blockchain-Ansatz schützt vor bestimmten Arten von Deep Fakes, genauso wie die Bildverarbeitung durch maschinelles Lernen vor bestimmten Arten von Deep Fakes schützt“, sagte er.

Die Quintessenz, so scheint es, ist Wachsamkeit für uns alle, wenn es darum geht, die kommende Deepfake-Flut zu bekämpfen.