Deepfake Tech Facebooku nás nezachrání, říkají odborníci

- Vzhledem k tomu, že je vytváření deepfakes snazší, prioritou se staly nové a vylepšené způsoby, jak je odhalit.

- Technologie deepfake-spotting od Facebooku využívá zpětné strojové učení k odhalení, zda je video deepfake nebo ne.

- Odborníci tvrdí, že použití technologie blockchain by bylo nejlepším způsobem, jak zjistit, zda je video skutečné, nebo ne, protože metoda spoléhá na kontextová data.

Getty Images

Facebook si je jistý model strojového učení pro boj s deepfakes, ale odborníci tvrdí, že samotné strojové učení nás nezachrání před oklamáním deepfakes.

Společnosti jako Facebook, Microsoft a Google všichni pracují na boji proti deepfake šíření po webu a sociálních sítích. I když se metody liší, existuje jedna potenciální spolehlivá metoda, jak tato falešná videa odhalit: blockchainy.

„[Blockchains] vám dává spoustu potenciálu ověřit deepfake způsobem, který je nejlepší formou ověření, jakou jsem viděl,“ Stephen Wolfram, zakladatel a CEO společnosti Wolfram Research a autorem Nový druh vědy, řekl Lifewire po telefonu.

Facebook Deepfake-Spotting Tech

Technologie Deepfake za posledních několik let rychle rostla. Zavádějící videa využívají metody strojového učení k provádění věcí, jako je překrytí něčí tváře na tělo jiné osoby, změna podmínek pozadí, falešná synchronizace rtů a další. Pohybují se od neškodných parodií až po nutí celebrity nebo veřejné osobnosti říkat nebo dělat něco, co neudělali.

Odborníci říkají, že technologie se rychle rozvíjí a že deepfakes budou přesvědčivější (a snáze se vytvoří), až se technologie stane dostupnější a inovativnější.

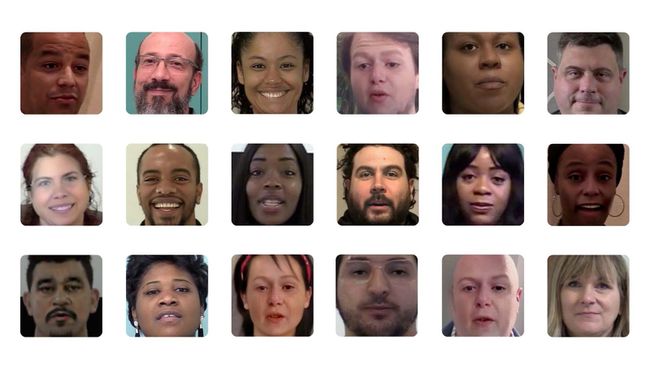

ApolitikNow / Flickr / CC Od 2.0

Facebook nedávno ve spolupráci s Michigan State University poskytl více informací o své technologii detekce deepfake. Sociální síť říká, že se spoléhá na reverzní inženýrství od jediného obrázku generovaného umělou inteligencí až po generativní model použitý k jeho výrobě.

Vědci z výzkumu, kteří spolupracovali s Facebookem, uvedli, že metoda spoléhá na odhalení jedinečných vzorů za modelem umělé inteligence, který se používá ke generování deepfake.

„Zobecněním atribuce obrazu na rozpoznávání otevřené sady můžeme odvodit více informací o generativní model používaný k vytvoření deepfake, který přesahuje poznání, že nebyl viděn před. A sledováním podobností mezi vzory sbírky deepfakes bychom také mohli zjistit, zda vznikla série obrázků z jednoho zdroje,“ napsali výzkumní vědci Xi Yin a Tan Hassner v blogovém příspěvku na Facebooku o jeho deepfake-spottingu. metoda.

Wolfram říká, že dává smysl, že byste použili strojové učení k odhalení pokročilého modelu umělé inteligence (deepfake). Vždy je však prostor pro oklamání technologie.

„Vůbec mě nepřekvapuje, že existuje slušný způsob strojového učení [detekce deepfakes],“ řekl Wolfram. „Jediná otázka je, jestli vynaložíte dostatečné úsilí, dokážete to oklamat? Jsem si jistý, že můžeš."

Boj proti Deepfakes jiným způsobem

Místo toho Wolfram řekl, že věří, že použití blockchainu by bylo nejlepší možností, jak přesně lokalizovat určité typy deepfakes. Jeho názor na používání blockchainu před strojovým učením sahá až do roku 2019 a řekl, že v konečném důsledku může blockchainový přístup poskytnout přesnější řešení našeho problému deepfake.

„Očekával bych, že diváci obrázků a videí by se mohli běžně porovnávat s blockchainy (a ‚triangulací dat computations') trochu jako to, jak nyní webové prohlížeče kontrolují bezpečnostní certifikáty,“ napsal Wolfram v článku publikováno ve Scientific American.

Vzhledem k tomu, že blockchainy ukládají data do bloků, které jsou následně zřetězeny dohromady v chronologickém pořadí, a protože decentralizované blockchainy jsou neměnné, zadaná data jsou nevratná.

„Jediná otázka je, jestli vynaložíte dostatečné úsilí, dokážete to oklamat? Jsem si jistý, že můžeš."

Wolfram vysvětlil, že když vložíte video do blockchainu, budete moci vidět čas, kdy bylo pořízeno, umístění a další kontextové informace, které by vám umožnily zjistit, zda bylo v nějaké změně způsob.

„Obecně platí, že čím více metadat uvádí obrázek nebo video do kontextu, tím je pravděpodobnější, že to budete schopni říct,“ řekl. "Na blockchainu nemůžete předstírat čas."

Wolfram však řekl, že použitá metoda – ať už je to strojové učení nebo používání blockchainu – závisí na typu deepfake, který zkoušíte. chránit před (tj. video, kde Kim Kardashian říká něco hloupého, nebo video politika, který dělá prohlášení nebo návrh).

„Blockchainový přístup chrání před určitými druhy hlubokých padělků, stejně jako zpracování obrazu pomocí strojového učení chrání před určitými druhy hlubokých padělků,“ řekl.

Zdá se, že základem je ostražitost nás všech, pokud jde o boj s nadcházející falešnou potopou.