Технологията Deepfake на Facebook няма да ни спаси, казват експерти

- Тъй като дълбоките фалшификати стават по-лесни за правене, новите и подобрени начини за забелязването им станаха приоритет.

- Технологията на Facebook за откриване на дълбоки фалшификати използва обратното машинно обучение, за да разкрие дали видеото е дълбоко фалшифициране или не.

- Експертите казват, че използването на блокчейн технология би било най-добрият начин да се види дали видеото е реално или не, тъй като методът разчита на контекстуални данни.

Getty Images

Facebook е уверен в това модел на машинно обучение за борба с дълбоките фалшификати, но експертите казват, че машинното обучение само по себе си няма да ни спаси от измамени от дълбоки фалшификати.

Компании като Facebook, Microsoft и Google всички работят за борба с дълбоките фалшификати от разпространение в мрежата и социалните мрежи. Въпреки че методите се различават, има един потенциален защитен метод за откриване на тези фалшиви видеоклипове: блокчейн.

„[Blockchains] просто ви дават много потенциал да потвърдите дълбокото фалшифициране по начин, който е най-добрата форма на валидиране, която виждам“, Стивън Волфрам, основател и главен изпълнителен директор на

Технологията Deepfake-Spotting на Facebook

Технологията Deepfake нарасна бързо през последните няколко години. Подвеждащите видеоклипове използват методи за машинно обучение, за да правят неща като наслагване на нечие лице върху тялото на друг човек, промяна на фоновите условия, фалшива синхронизация на устните и др. Те варират от безобидни пародии до каране на знаменитости или обществени личности да казват или правят нещо, което не са.

Експертите казват, че технологията напредва бързо и че дълбоките фалшификати ще стават все по-убедителни (и по-лесни за създаване), тъй като технологията става по-широко достъпна и по-иновативна.

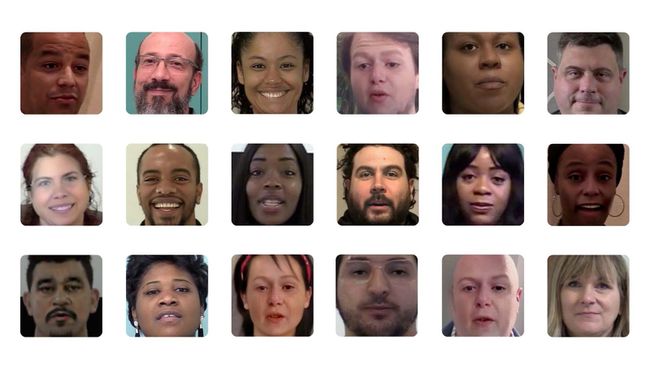

ApolitikNow / Flickr / CC By 2.0

Наскоро Facebook даде повече представа за своята технология за откриване на дълбоки фалшификати в партньорство с Мичиганския държавен университет. Социалната мрежа казва, че разчита на обратното инженерство от едно изображение, генерирано от изкуствен интелект, до генеративния модел, използван за производството му.

Изследователи, които са работили с Facebook, казаха, че методът разчита на разкриването на уникалните модели зад модела на AI, използван за генериране на дълбоко фалшифициране.

„Като обобщаваме приписването на изображения към разпознаването с отворен набор, можем да извлечем повече информация за генеративен модел, използван за създаване на дълбоко фалшифициране, което надхвърля разпознаването, че не е видяно преди. И като проследим приликите между моделите на колекция от дълбоки фалшификати, можем също да разберем дали серия от изображения произхожда от един източник“, написаха изследователите Си Ин и Тан Хаснер в публикация в блога на Facebook за нейното дълбоко фалшифициране метод.

Волфрам казва, че има смисъл да използвате машинно обучение, за да забележите усъвършенстван AI модел (дълбоко фалшифициране). Въпреки това, винаги има място да се заблуди технологията.

„Изобщо не съм изненадан, че има приличен начин за машинно обучение за [откриване на дълбоки фалшификати]“, каза Волфрам. „Единственият въпрос е, ако положите достатъчно усилия, можете ли да го заблудите? Сигурен съм, че можеш.”

Борбата с Deepfakes по различен начин

Вместо това Волфрам каза, че вярва, че използването на блокчейн би било най-добрият вариант за точно откриване на определени видове дълбоки фалшификати. Неговото мнение за използването на блокчейн над машинното обучение датира от 2019 г. и той каза, че в крайна сметка подходът на блокчейн може да осигури по-точно решение на нашия проблем с дълбоки фалшификати.

„Очаквам, че зрителите на изображения и видео могат рутинно да проверяват срещу блокчейн (и „триангулация на данни“). изчисления“) малко като това как уеб браузърите сега проверяват сертификатите за сигурност“, пише Волфрам в статия публикуван в Scientific American.

Тъй като блокчейновете съхраняват данни в блокове, които след това са свързани заедно в хронологичен ред, и тъй като децентрализираните блокчейн са неизменни, въведените данни са необратими.

„Единственият въпрос е, ако положите достатъчно усилия, можете ли да го заблудите? Сигурен съм, че можеш."

Волфрам обясни, че като поставите видео в блокчейн, ще можете да видите времето, когато е заснето, местоположението и друга контекстуална информация, която би ви позволила да разберете дали е променена в някое начин.

„Като цяло, като имате повече метаданни, които контекстуализират картината или видеото, толкова по-вероятно е да можете да разберете“, каза той. "Не можете да фалшифицирате времето в блокчейн."

Въпреки това Волфрам каза, че използваният метод - независимо дали е машинно обучение или използване на блокчейн - зависи от типа дълбоко фалшифициране, което опитвате за защита срещу (т.е. видео на Ким Кардашиян, която казва нещо глупаво или видео на политик, който прави изявление или внушение).

„Подходът на блокчейн защитава от определени видове дълбоки фалшификати, точно както обработката на изображения с машинно обучение предпазва от определени видове дълбоки фалшификати“, каза той.

Изглежда, че изводът е бдителност за всички нас, когато става въпрос за борба с предстоящия дълбоко фалшив потоп.